Google lanza Gemini 3: el nuevo modelo promete avances en razonamiento, código y automatización

Google ha comenzado a implementar Géminis 3una nueva generación de modelos que redefine la estrategia de IA de la compañía para el consumo, la productividad y el desarrollo.

La empresa presenta el sistema como su modelo más preciso e inteligente hasta la fecha y lanza el Géminis 3 Pro directamente en la aplicación Gemini, AI Studio y Search AI Mode desde el primer día.

La medida también continúa la disputa con OpenAI y Anthropic, ya que el anuncio se produce pocos días después de la llegada de GPT-5.1 y semanas después de la Soneto 4.5.

Nuevo enfoque: interpretar la intención y reducir los pedidos largos

Gemini 3 está diseñado para comprender el contexto más profundamente. La premisa es que el modelo pueda identificar lo que el usuario realmente necesita sin depender de instrucciones extensas.

Además, Google está trabajando para cambiar la forma en que habla el modelo. Según Tulsee Doshi, director de producto de Google DeepMind, el objetivo es ofrecer respuestas más directas, consistentes y libres de elogios automáticos.

En entrevista con vehículos internacionales, afirmó que el sistema busca ir más allá de la conversación genérica para funcionar como un “Socio pensado capaz de aportar ángulos que no habrías descubierto por tu cuenta”lo que ayuda a explicar el cambio en el comportamiento de respuesta.

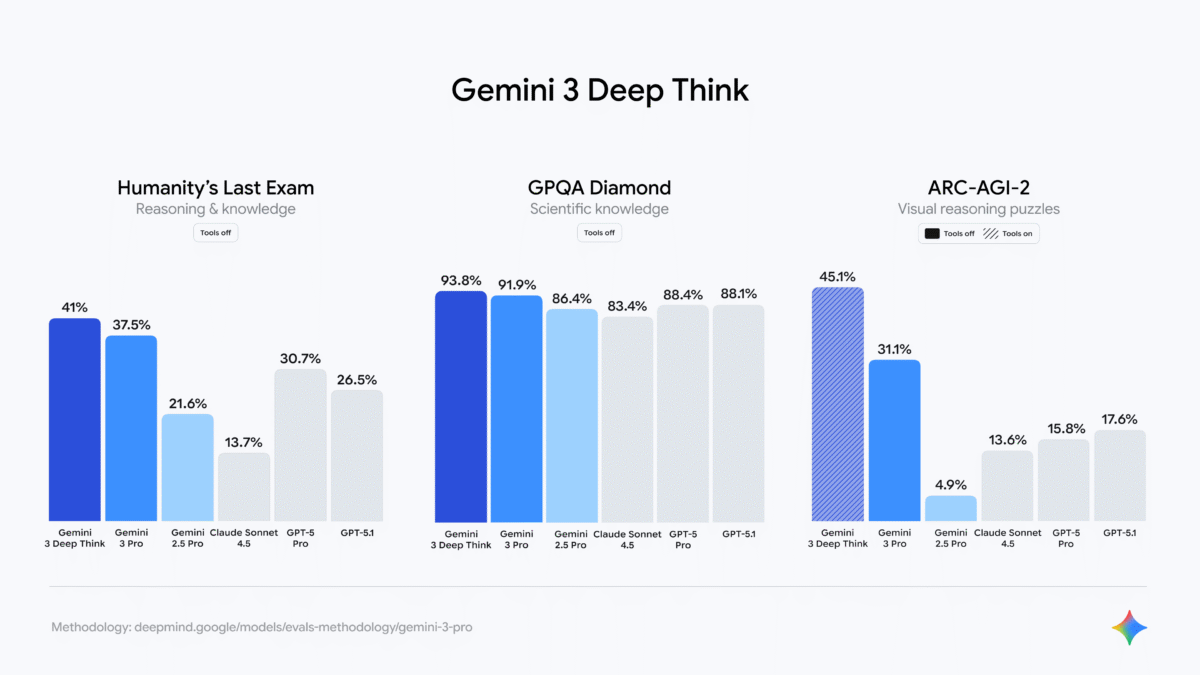

Razonamiento profundo y puntos de referencia sin precedentes

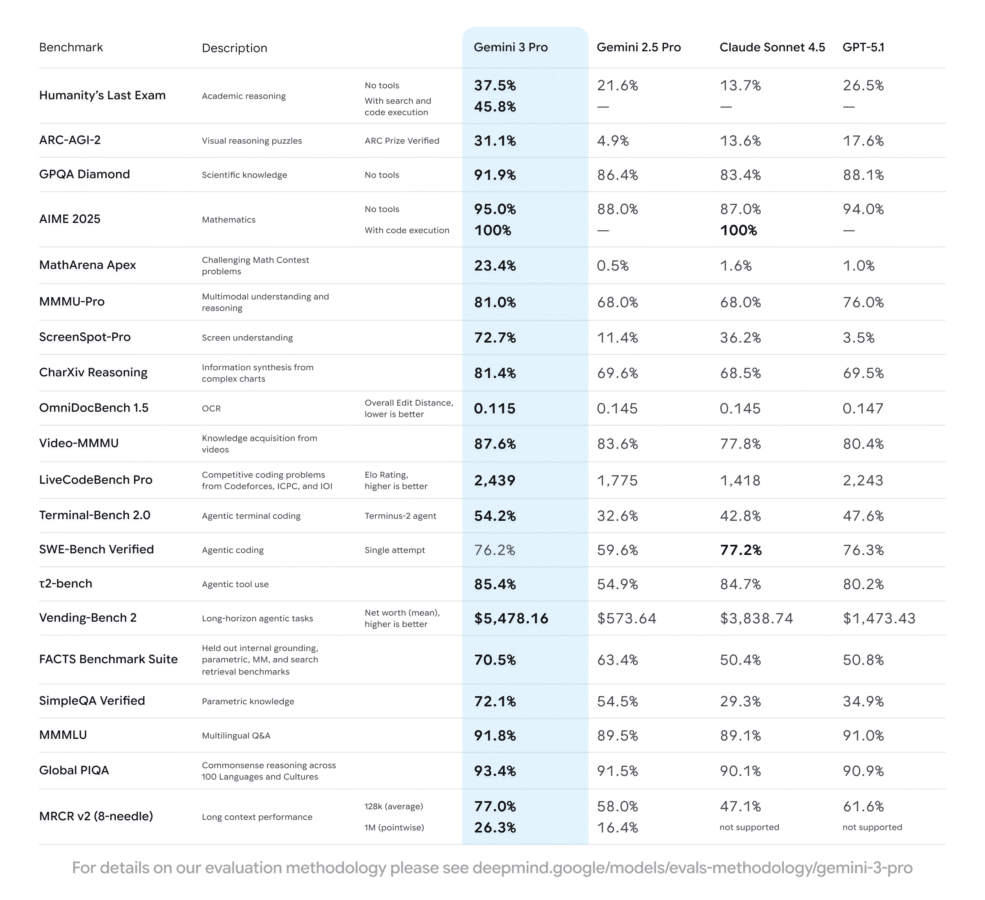

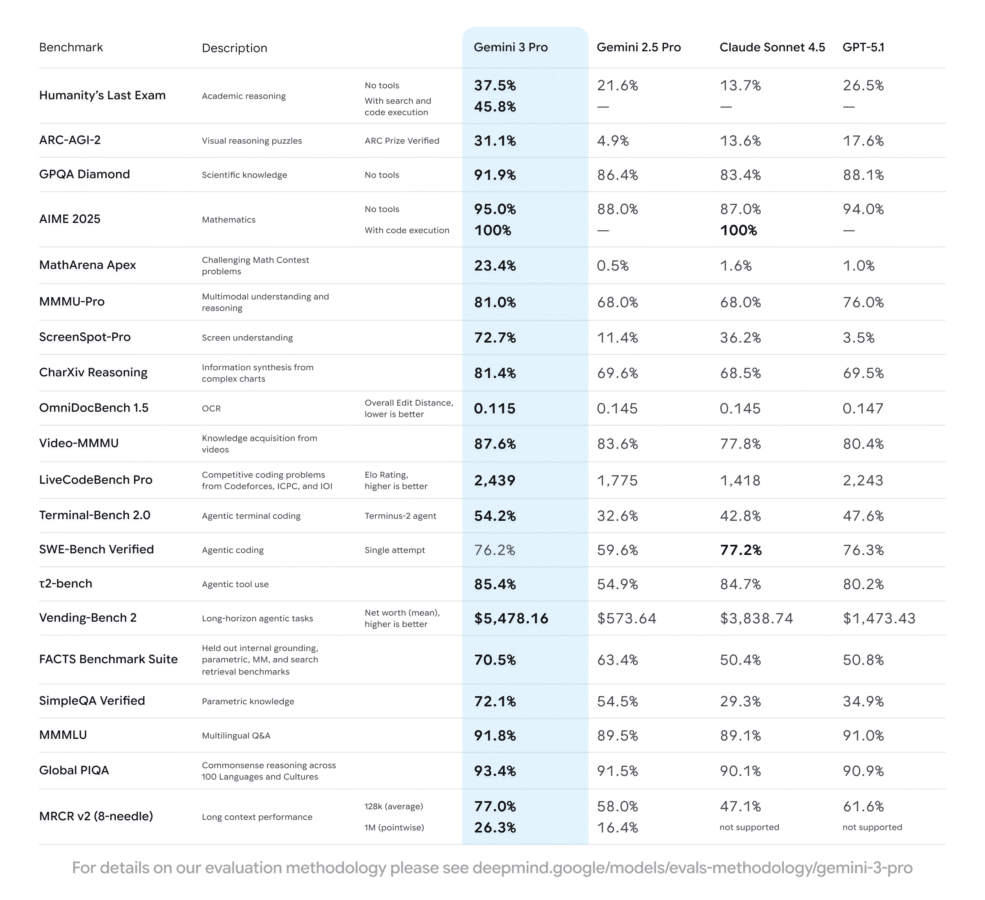

La nueva versión logró algunos de los mejores resultados jamás registrados en evaluaciones independientes:

- 37,4% en el último examen de la humanidadsuperando el récord anterior y manteniendo un alto rendimiento incluso sin recurrir a herramientas externas.

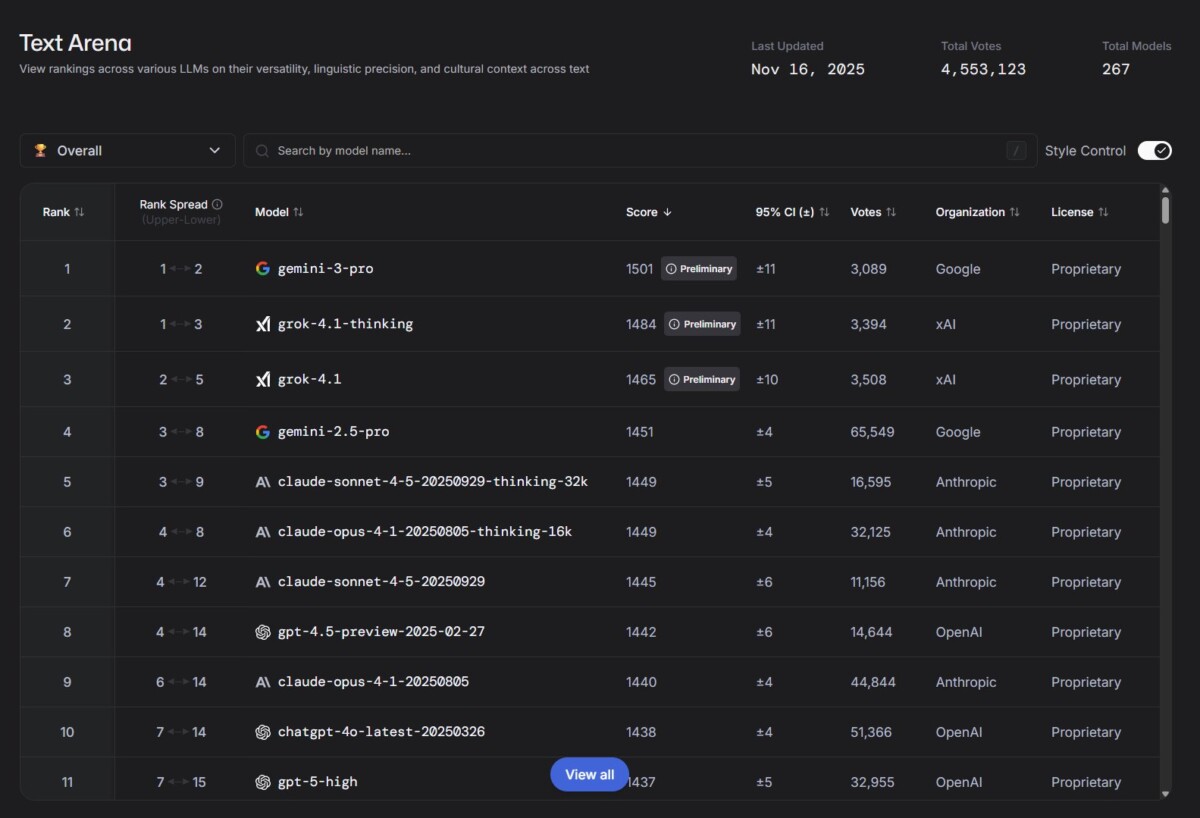

- 1501 puntos en LMArenaque combina evaluaciones humanas de claridad, utilidad y precisión.

- Máxima puntuación en GPQA Diamante (91,9%)dirigido a tareas complejas y altamente especializadas.

- Avances significativos en matemáticas, con 23,4% en MathArena Apex.

- Puntuaciones superiores en evaluaciones multimodales como 87,6% en Vídeo-MMMU.

- Dominio en benchmarks de programación: 76,2% en SWE-bench Verificado y 1487 ELO en WebDev Arena.

El rendimiento refuerza que el modelo fue calibrado para interpretar problemas largos, resolver pasos encadenados y respaldar decisiones a lo largo de tareas más largas, algo que todavía es poco común en los sistemas de IA de uso público.

| Categoría | ¿Qué cambia en Géminis 3? | Impacto práctico |

|---|---|---|

| Razonamiento | Aumento significativo en puntos de referencia como Humanity’s Last Exam (37,4%) y Deep Think (41%) | Respuestas más profundas, análisis largos más precisos y menos riesgo de “romper” la cadena lógica |

| Multimodalidad | Mejora en MMMU-Pro (81%) y Video-MMMU (87,6%) | Mejor interpretación de imágenes, vídeos e indicaciones híbridas. |

| factualidad | Avance en SimpleQA verificado (72,1%) | Respuestas con menos alucinaciones y datos más consistentes |

| Código | Mejor rendimiento en WebDev Arena (1487), SWE-bench Verified (76,2%) y Terminal-Bench 2.0 | Realizar tareas de programación complejas y utilizar herramientas. |

| Agentes | Llegada del Agente Géminis a la aplicación | IA capaz de realizar tareas completas (correos electrónicos, organización, investigación) |

| IU generativa | La vista dinámica y el diseño visual crean interfaces y vistas | Respuestas en formato app, simuladores, páginas, galerías y herramientas interactivas |

| Comportamiento en las respuestas | Reducción de piropos automáticos y frases genéricas | Tono más directo, conciso y analítico |

| Búsqueda (modo AI) | Consulta de distribución más amplia e inteligente | Búsqueda más profunda, con más fuentes y mayor precisión contextual |

| Disponibilidad | Lanzamiento simultáneo en aplicación, búsqueda y AI Studio | Acceso más amplio para usuarios y desarrolladores |

| Modo avanzado | Deep Think disponible para los evaluadores y luego para los suscriptores de Ultra | Razonamiento extendido, útil para problemas complejos y pasos encadenados. |

| Herramientas para desarrolladores | Lanzamiento de Google Antigravity, IDE agente | Desarrollo asistido con agentes trabajando en editor, terminal y navegador. |

| API y estudio | Vista previa de Gemini 3 Pro lanzada en Google AI Studio | Permite realizar pruebas, integración y creación de prototipos de forma inmediata. |

El dominio del código y la llegada de la antigravedad

El salto en programación se presenta en dos frentes. El primero es el razonamiento propio del modelo, que ahora ejecuta instrucciones complejas con mayor claridad. El segundo es el lanzamiento de Antigravedad de Googleun entorno agente que combina editor, terminal y navegador en una única interfaz.

La propuesta es permitir al agente Gemini ejecutar bloques completos de trabajo: analizar archivos, proponer soluciones, editar secciones, validar resultados y ajustar el proyecto.

Antigravity utiliza componentes de Gemini 3, el modelo de uso de la computadora, y herramientas auxiliares para moverse entre diferentes etapas de desarrollo sin una supervisión constante.

Generación de interfaces y multimodalidad más madura

Gemini 3 mantiene el enfoque multimodal nativo y amplía su capacidad para transformar conceptos abstractos en visualizaciones, fragmentos de código, representaciones matemáticas o interfaces interactivas.

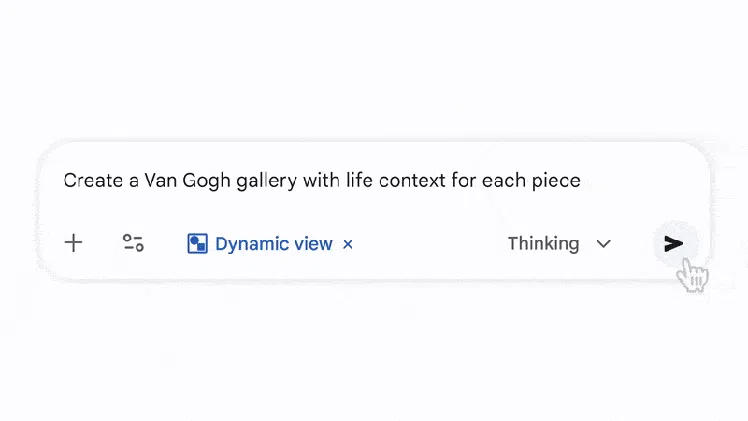

La empresa incluía dos interfaz de usuario generativaque empiezan a aparecer en la aplicación Gemini:

- Vista dinámicaque crea diseños interactivos adaptados a cada solicitud, como calculadoras, páginas explicativas o simuladores.

- Diseño visualque organiza el contenido en formato revista, con módulos, galerías y elementos navegables.

La idea es crear respuestas que se acerquen más a la experiencia de una aplicación, no solo a un texto.

Agente Gemini y la automatización de tareas cotidianas

Dentro de la aplicación Gemini, Gemini 3 Pro activa el Agente Géminisuna función que realiza tareas completas en lugar de simplemente guiarlas. El sistema puede navegar por correos electrónicos, organizar bandejas de entrada, estructurar búsquedas largas y realizar acciones que involucran múltiples aplicaciones, siempre que el usuario permita el acceso a las cuentas.

La mecánica amplía conceptos probados en el proyecto Mariner, que permitió a Chrome navegar y recopilar información de forma autónoma. Ahora, la propuesta es llevar esta automatización a flujos de trabajo más amplios.

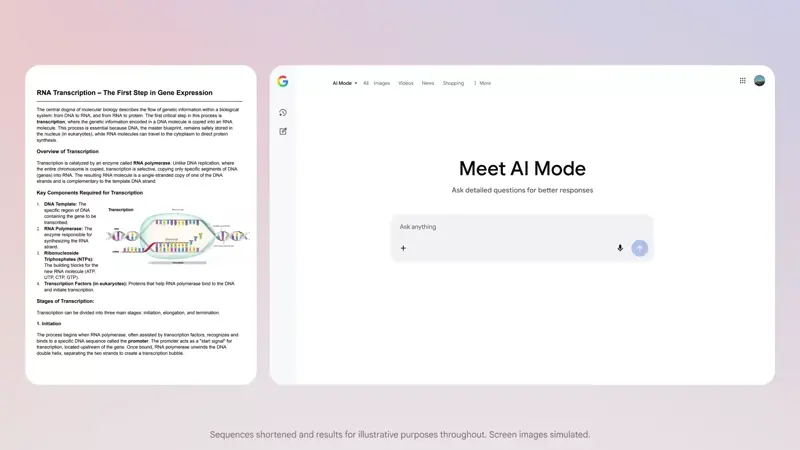

En Búsqueda, el Gemini 3 Pro debuta dentro del Modo IAque aparece inicialmente para suscriptores Pro y Ultra.

Google ha revisado el método “fan-out”, una técnica que divide una pregunta en varias subpreguntas para realizar búsquedas paralelas. Según la empresa, el modelo ahora puede identificar matices que antes habrían pasado desapercibidos, encontrar fuentes adicionales y reconstruir respuestas más completas.

Las respuestas ahora incluyen gráficos, simulaciones y herramientas interactivas, como calculadoras de financiación o visualizaciones científicas.

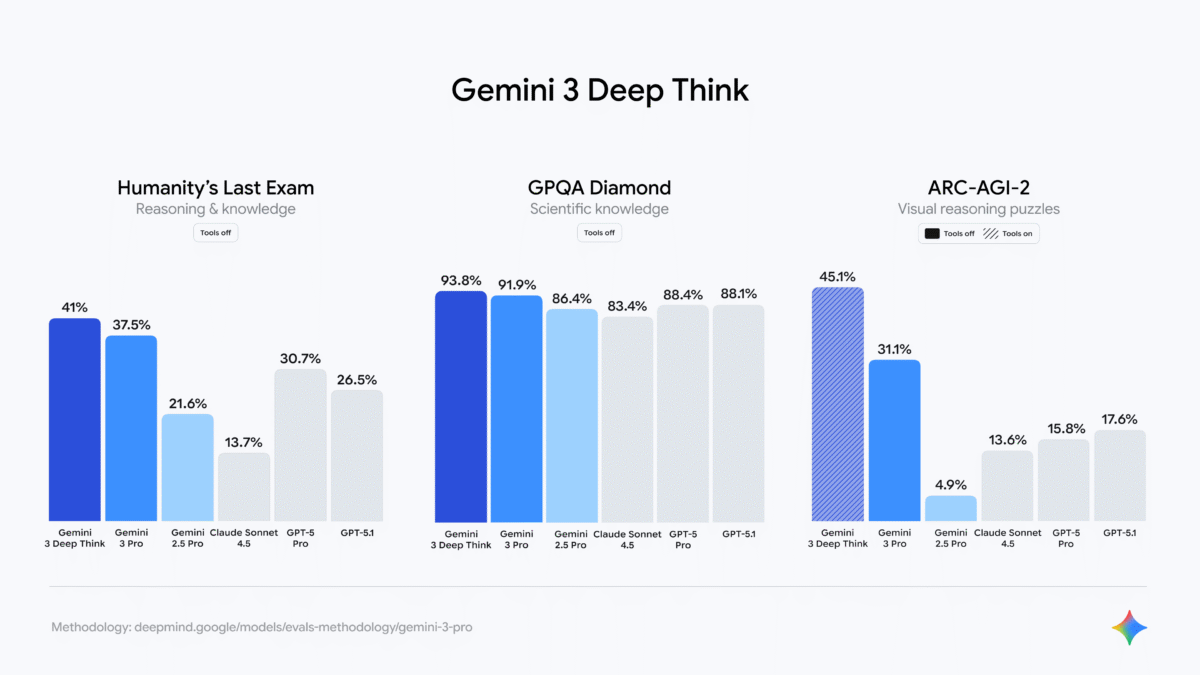

En las próximas semanas, Google tiene la intención de lanzar el Géminis 3 Pensamiento profundo para suscriptores Ultra. El modo amplía el razonamiento del modelo y logra resultados superiores:

- 41% en el último examen de la humanidad

- 93,8% en GPQA Diamante

- 45,1% en ARC-AGI con ejecución de código

La versión también combina análisis multimodal con razonamiento extendido, haciendo que el procesamiento de problemas complejos sea menos propenso a errores de secuencia.

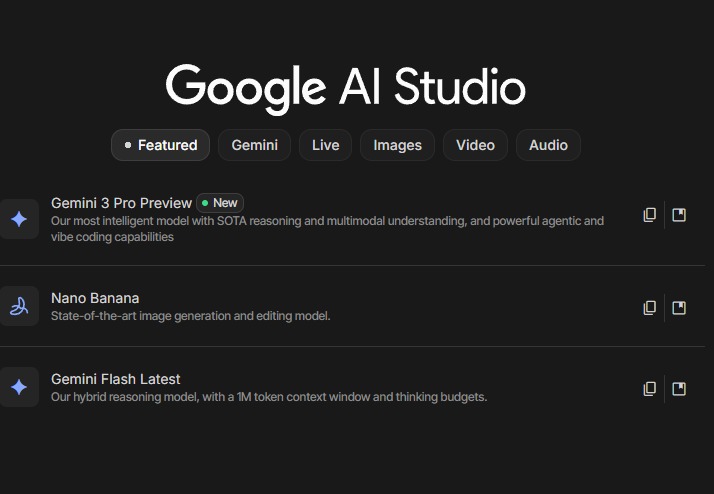

Gemini 3 Pro también aparece en AI Studio

Además de la aplicación Gemini y el modo AI en la búsqueda, el Vista previa de Géminis 3 Pro ahora está disponible dentro Estudio de IA de Googleun entorno utilizado por los desarrolladores para probar solicitudes, crear canales de inferencia e integrar modelos a través de API. La plataforma enumera el modelo como una opción inmediata, lo que le permite explorar el razonamiento, la multimodalidad y los agentes antes del lanzamiento completo.

AI Studio también muestra otros modelos experimentales, como el Nano Banana para generación y edición de imágenes, pero la presencia del Gemini 3 Pro en la página de inicio deja claro que Google quiere acelerar la adopción del nuevo sistema en el ecosistema de desarrollo.

El lanzamiento anticipado facilita la validación de flujos complejos, la prueba de llamadas multimodales y el análisis del comportamiento del modelo en escenarios de producción, algo que suele ocurrir semanas después en versiones anteriores de la familia Gemini.

Con más de 650 millones de usuarios activos en la aplicación Gemini y 13 millones de desarrolladores que han utilizado la plataforma en algún momento, la llegada de Gemini 3 cambia la dinámica entre los principales modelos.

Google ahora compite no sólo por los puntos de referencia, sino también por la capacidad de transformar modelos en interfaces más útiles para el público final.

La inclusión de agentes, la generación de interfaces y la automatización sostenida indican que el foco pasa a ser el trabajo práctico, y no sólo la conversación.

Para el usuario medio, esto cambia la forma en que la IA participa en la investigación, los estudios y la organización digital; Para los desarrolladores, Antigravity señala una nueva fase de entornos agentes.

Nano Banana 2: que esperar de la nueva generación del modelo de imágenes de Google

Mientras Gemini 3 domina el foco de atención con sus avances en razonamiento y agentes, otro componente del ecosistema de Google también se está moviendo: la próxima generación del modelo visual conocido como nanoplátano.

Fuentes internas y documentación reciente sugieren que se está produciendo una evolución, denominada informalmente nanoplátano 2.

La actualización debería centrarse principalmente en tres frentes:

- Calidad visual mejoradacon más detalles y mejor coherencia entre estilos en indicaciones complejas.

- Herramientas de edición más precisaspermitiendo ajustes de áreas específicas, reemplazos inteligentes y manipulación de objetos.

- Integración más profunda con Gemini 3conectando texto, imágenes y diseño en una única cadena multimodal.

El objetivo es que Nano Banana 2 funcione como un brazo visual del ecosistema Gemini, ampliando la capacidad de generar interfaces, prototipos, elementos gráficos y composiciones que complementen las capacidades de automatización y razonamiento del modelo principal.

Lea también:

Lo que este lanzamiento comienza a transformar

Gemini 3 marca un punto donde los modelos dejan de responder preguntas y comienzan montar experiencias completasacercando la IA a herramientas que construyen, prueban, simulan y ejecutan. El impacto real se medirá en los próximos meses a medida que los agentes, las interfaces generadas y los modos avanzados se lancen a escala global.

Fuente: Google